1. Spark Streaming 是什么 ?

Spark Streaming 是 Spark Core 的扩展API

用来支持 高吞吐、高容错的 处理 流式数据

数据源可以是 : Kafka、TCP sockets、Flume、Twitter等流式数据源

处理数据: 可以用 Spark Core的算子 map、reduce、join、window 来处理数据

数据输出: 可以将处理后的数据 输出到 文件系统(HDFS)、数据库、live dashboards(实时仪表盘)

Spark Streaming是Spark的上一代 流式引擎

Spark Streaming 不在更新,它是一个传统项目

Spark 现在又提供了一个 更新、更容易使用的流式引擎,Spark Structured Streaming

2. Spark Streaming 工作流程 ?

Spark Streaming接收实时的输入数据流

将数据进行批量处理,再由Spark引擎进行处理,最终批量生成结果流 (本质还是将数据 封装成RDD 进行处理)

Receiver 接收数据流 -> 生成 DStream(一系列RDD) -> SparkConext 处理 RDD -> 输出处理结果

本篇内容介绍了“Spark通讯录相似度计算怎么实现”的有关知识...

本篇内容介绍了“Spark通讯录相似度计算怎么实现”的有关知识... 本篇内容主要讲解“Spark Shuffle和Hadoop Shuffle有哪些区别...

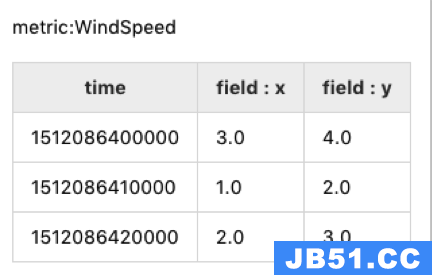

本篇内容主要讲解“Spark Shuffle和Hadoop Shuffle有哪些区别... 这篇文章主要介绍“TSDB的数据怎么利用Hadoop/spark集群做数...

这篇文章主要介绍“TSDB的数据怎么利用Hadoop/spark集群做数...