- 池化层在NLP应用

- MLM是什么

- 多层感知器-MLP

- 全连接层到底用来干什么?

- 因子分解机

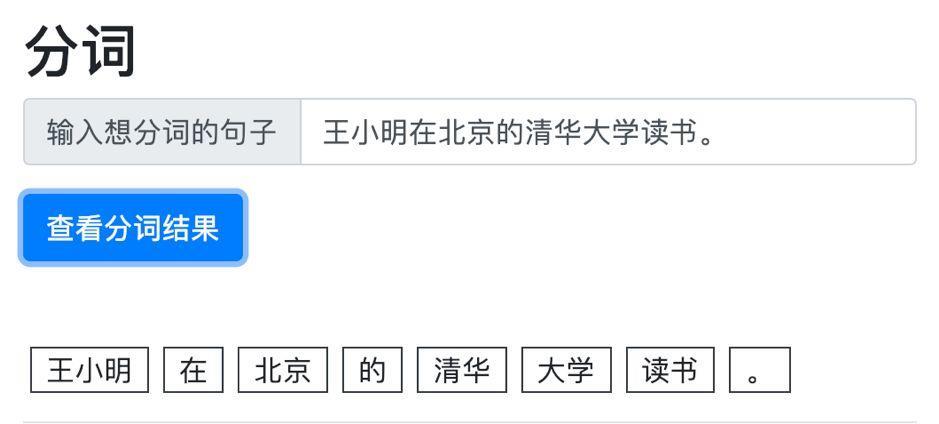

- token和span

- 整理一下tensor的类型

- 深度学习中Attention与全连接层的区别何在?

- 张量操作

- 词嵌入维度,如何选择?

- word2vec实现

池化层在NLP应用

MLM是什么

- 实际上就是掩码语言模型(Masked Language Model),比如大家常说的Bert、GPT、EMLo等都是属于MLM,只是掩码的种类不同而已。MLM的做法就是随机屏蔽输入序列的一些token,然后仅仅通过上下文来预测被屏蔽token的原单词表id。

- 参考一 、参考二

多层感知器-MLP

全连接层到底用来干什么?

-

首先最常见的功能就是转变维度,即输出符合要维度,此外全连接层出现在后几层还可能是用来对前面的特征做加权和,以此获得更多的信息提取特征,实现分类(CNN中是这样的),但是一层全连接层没法解决非线性问题,如果有两层以上就可以了,比如前馈层(两个全连接层)。此外相比于self-attention全连接层的权重更多以位置为基准

-

在神经网络中通常还会与softmax中进行结合,全连接层将权重矩阵与输入向量相乘再加上偏置,将n个的实数映射为K个的实数(分数);softmax将K个的实数映射为K个0~1的实数(概率),同时保证它们之和为1。

因子分解机

token和span

整理一下tensor的类型

深度学习中Attention与全连接层的区别何在?

张量操作

词嵌入维度,如何选择?

- 可以参考苏神的这篇博客:关于维度公式“n > 8.33 log N”的可用性分析

word2vec实现

- 可以参考wmathor大佬的这篇博客:Word2Vec 的 PyTorch 实现(乞丐版)