在OpenNLP中训练的截止和迭代是什么意思?或者就此而言,自然语言处理.我只需要一个外行解释这些术语.据我所知,迭代是算法重复的次数,并且截断是一个值,如果文本的值高于某个特定类别的截止值,它将被映射到该类别.我对吗?

解决方法

正确地,术语迭代指的是迭代算法的一般概念,其中一个通过连续产生(希望越来越精确)一些“理想”解的近似来着手解决问题.一般而言,迭代越多,结果就越准确(“更好”),但当然必须执行更多的计算步骤.

术语截止(aka cutoff frequency)用于指定减小n-gram语言模型的大小的方法(如OpenNLP所使用的,例如其词性标注器).请考虑以下示例:

Sentence 1 = "The cat likes mice."

Sentence 2 = "The cat likes fish."

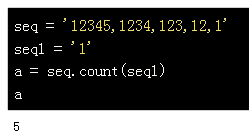

Bigram model = {"the cat" : 2,"cat likes" : 2,"likes mice" : 1,"likes fish" : 1}

如果在此示例中将截止频率设置为1,则n-gram模型将减少为

Bigram model = {"the cat" : 2,"cat likes" : 2}

也就是说,截止方法从语言模型中移除在训练数据中不常发生的那些n-gram.缩小n-gram语言模型的大小有时是必要的,因为甚至bigrams(更不用说三元组,4克等)的数量会爆发更大的语料库.然后可以使用再生信息(n-gram计数)来统计估计给定的单词(或其POS标签)的概率.第(n-1)以前单词(或POS标签).