假设我有一个1 TB的数据文件mmapped读/写从“主”

Linux系统的localy挂载的hdd文件系统进入在同一“主”系统上运行的进程的虚拟地址空间.

我有20个专用的“奴隶”Linux服务器,通过千兆交换机连接到“主”系统.我希望通过将其只读进入其进程地址空间,在这些“从”服务器上对此1 TB进行随机读取访问.

我的问题是,从主系统到从系统同步(可能是懒惰)数据集的最有效方法是什么? (例如,是否可以通过NFS挂载文件,然后从那里对其进行mmap?如果是,这是最好的解决方案吗?如果不是,那么解决方案是什么?)

解决方法

我最近在工作中一直在玩这样的想法(当然,文件大小要小得多).我相信NFS可以很好地读取,但你可能遇到并发写入的问题.如果你只有一个“作家”,那么你的想法应该合理地运作.如果数据文件是结构化的,我建议使用某些描述的分布式缓存,并允许在群集中分布数据的多个副本(用于冗余).

最后,我们选择了SAN和集群文件系统解决方案(在我们的案例中是Symantec VCS,但任何通用的集群文件系统都可以).我们这样做的原因是因为我们无法获得使用纯NFS所需的性能.您选择的集群文件系统需要正确支持mmap和分布式缓存.

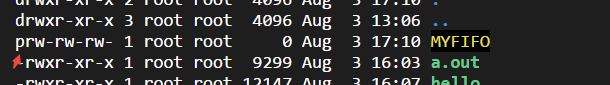

linux常用进程通信方式包括管道(pipe)、有名管道(FIFO)、...

linux常用进程通信方式包括管道(pipe)、有名管道(FIFO)、... Linux性能观测工具按类别可分为系统级别和进程级别,系统级别...

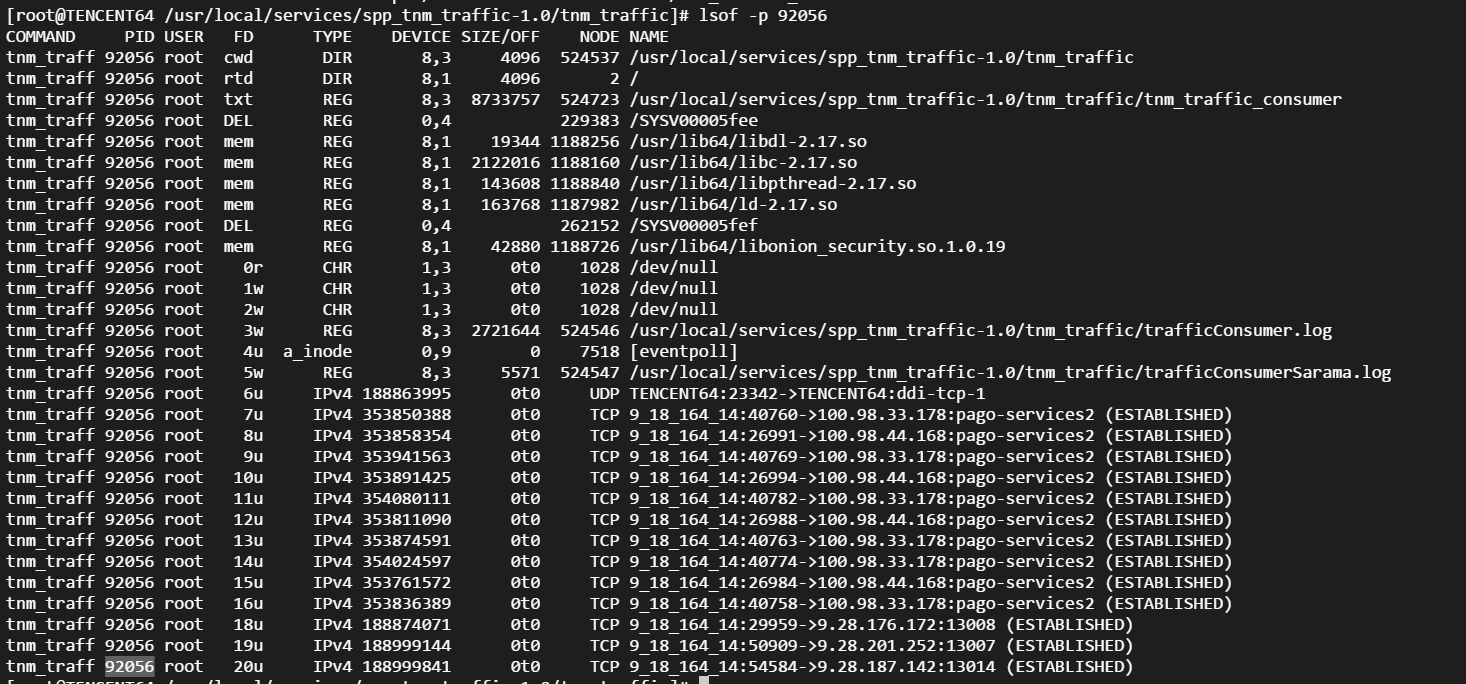

Linux性能观测工具按类别可分为系统级别和进程级别,系统级别... 本文包含作者工作中常用到的一些命令,用于诊断网络、磁盘占满...

本文包含作者工作中常用到的一些命令,用于诊断网络、磁盘占满... linux的平均负载表示运行态和就绪态及不可中断状态(正在io)的...

linux的平均负载表示运行态和就绪态及不可中断状态(正在io)的... CPU上下文频繁切换会导致系统性能下降,切换分为进程切换、线...

CPU上下文频繁切换会导致系统性能下降,切换分为进程切换、线...