问题描述

我具有查找两个句子的词级编辑距离的功能(末尾为全功能)。

levenshtein(c("How","do","you","do"),c("What","do"))

## [1] 1

我有很多句子的集合,并且正在计算集合中所有句子对的总编辑距离。

total <- 0

curr <- 0

n <- length(sentences)

for (i in (1:n)) {

for (j in (i + 1:n)) {

if (j > n) break

curr <- levenshtein(sentences[[i]],sentences[[j]])

total <- levenshtein.total + curr

}

}

这非常很慢,但是我不知道如何处理:

- 对levenshtein()进行基准测试在期间,for循环显示某些调用最多需要两分钟。

- 在控制台中对相同的通话(相同的句子对)进行基准测试,导致通话花费一秒钟。

我对R的细节不是很有经验,所以我希望能缺少一些明显的东西。遗憾的是,出于隐私原因,我无法提供任何特定的句子集。所有集合都包含大约100个句子,长度为1-100。

感谢您对这个问题的任何想法或对我的SO用法的一般想法。第一篇文章。

单词级Levenshtein函数:

levenshtein <- local({

memo <- list()

f <- function(sentence1,sentence2,len1=NULL,len2=NULL,offset1=0,offset2=0) {

if (is.null(len1)) len1 <- length(sentence1)

if (is.null(len2)) len2 <- length(sentence2)

key <- paste(c(toString(offset1),toString(len1),toString(offset2),toString(len2)),collapse = ",")

if (!is.null(memo[[key]])) return(memo[[key]])

if (len1 == 0) return(len2)

if (len2 == 0) return(len1)

cost <- 0

if (sentence1[[offset1 + 1]] != sentence2[[offset2 + 1]]) cost <- 1

dist <- min(

levenshtein(sentence1,len1 - 1,len2,offset1 + 1,offset2) + 1,levenshtein(sentence1,len1,len2 - 1,offset1,offset2 + 1) + 1,offset2 + 1) + cost

)

memo[key] <<- dist

return(dist)

}})

解决方法

临时解决方案

在每次函数调用后手动为备忘录变量分配一个空列表,可使例程快40倍左右。请参阅内部循环的最后一行。

total <- 0

curr <- 0

n <- length(sentences)

for (i in (1:n)) {

for (j in (i + 1:n)) {

if (j > n) break

curr <- levenshtein(sentences[[i]],sentences[[j]])

total <- levenshtein.total + curr

assign("memo",list(),envir = environment(levenshtein))

}

}

我不知道这对于一个根本上被忽视的问题有多少创可贴,但是我认为比不共享它更好。而且,如果有人对正在发生的事情有很好的了解,或者通过非元编程R的方式进行操作,那么我很乐于学习。

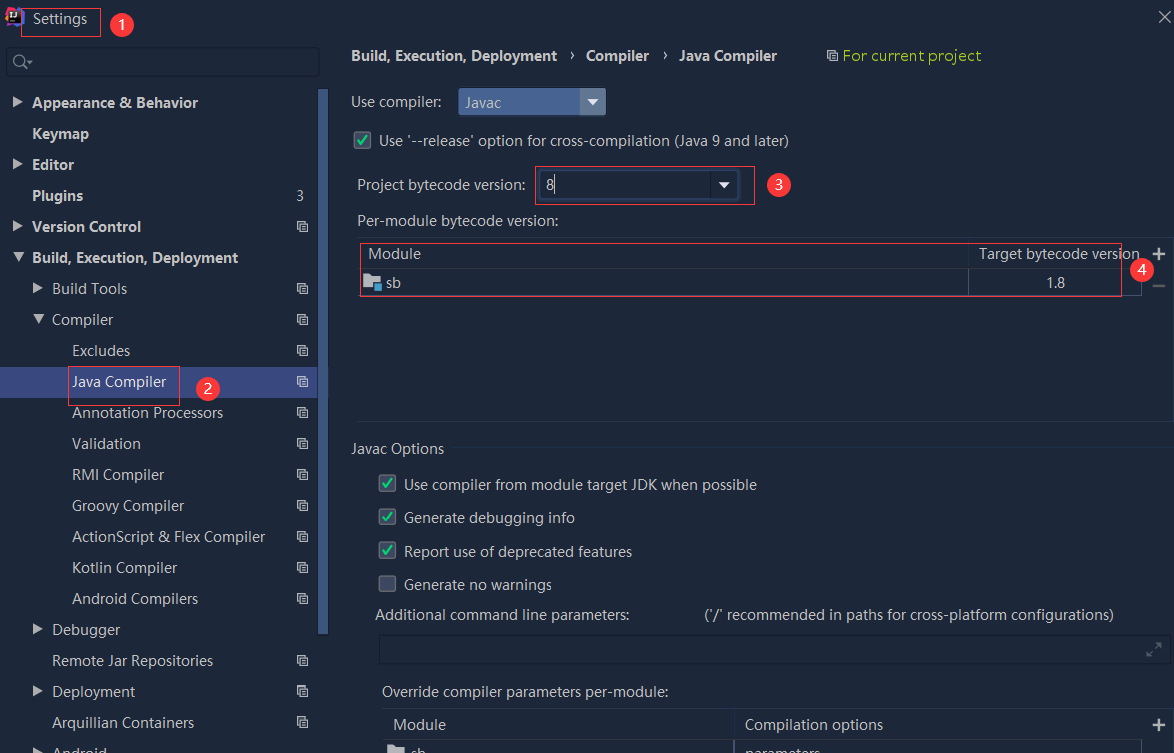

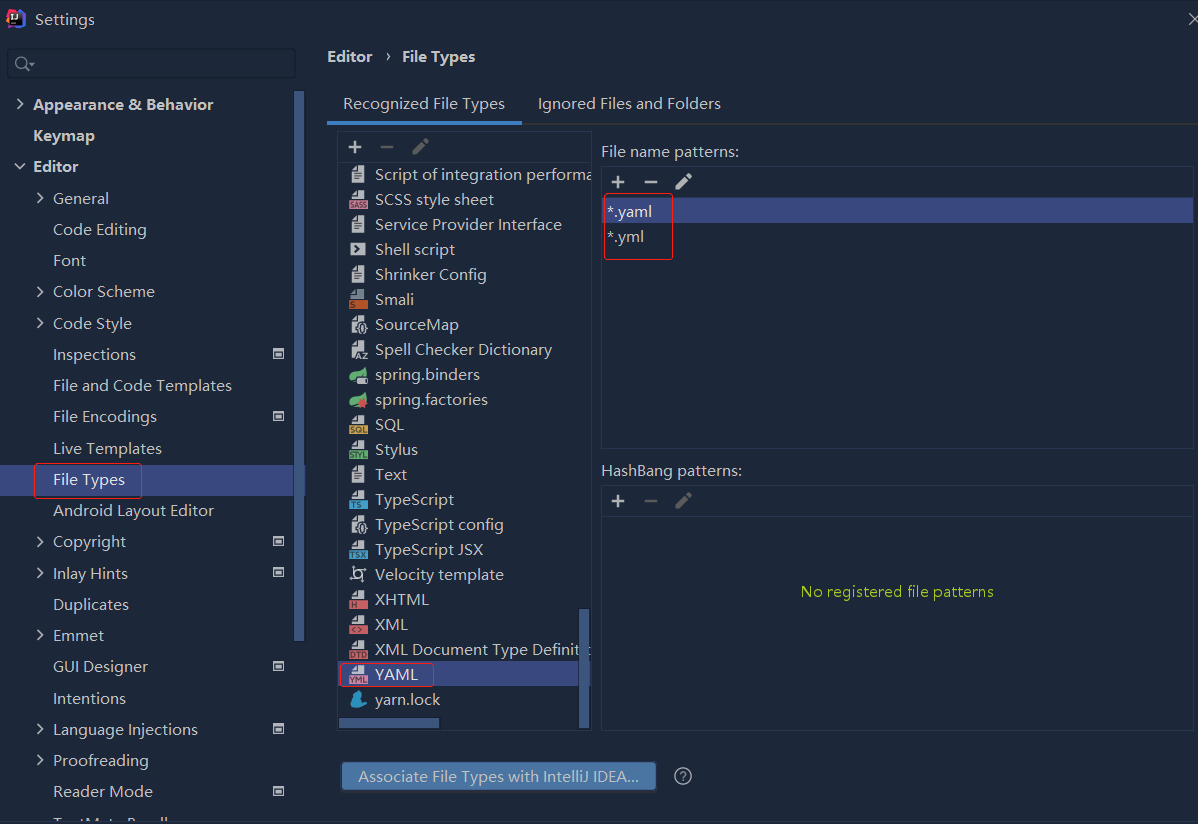

依赖报错 idea导入项目后依赖报错,解决方案:https://blog....

依赖报错 idea导入项目后依赖报错,解决方案:https://blog....

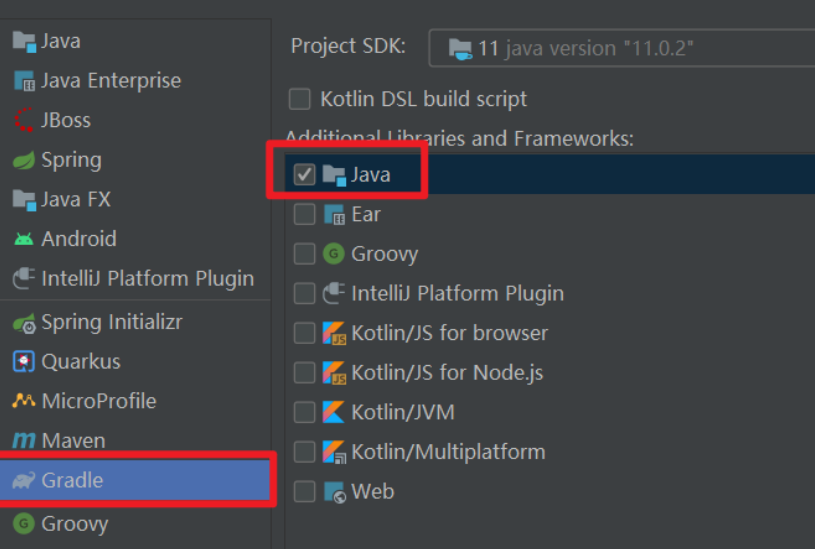

错误1:gradle项目控制台输出为乱码 # 解决方案:https://bl...

错误1:gradle项目控制台输出为乱码 # 解决方案:https://bl...