问题描述

我正在尝试从命令行使用spark-submit运行pyspark docker应用程序。

应用程序脚本可在调用spark-submit的目录中找到。

下面是代码:

user@ubuntu$ pwd

/home/ubuntu/

user@ubuntu$ ls

test_spark.py

## Attempt 1

user@ubuntu$ docker run --rm -it --link master:master htc/spark-submit spark-submit --master spark://172.17.0.1:7077 /home/ubuntu/test_spark.py

## Attempt2

user@ubuntu$ docker run --rm -it --link master:master htc/spark-submit spark-submit --master spark://172.17.0.1:7077 test_spark.py

但是在上述两种情况下,脚本抛出错误都说'没有这样的文件'

想知道如何在同一目录中运行spark应用程序吗?

谢谢

解决方法

暂无找到可以解决该程序问题的有效方法,小编努力寻找整理中!

如果你已经找到好的解决方法,欢迎将解决方案带上本链接一起发送给小编。

小编邮箱:dio#foxmail.com (将#修改为@)

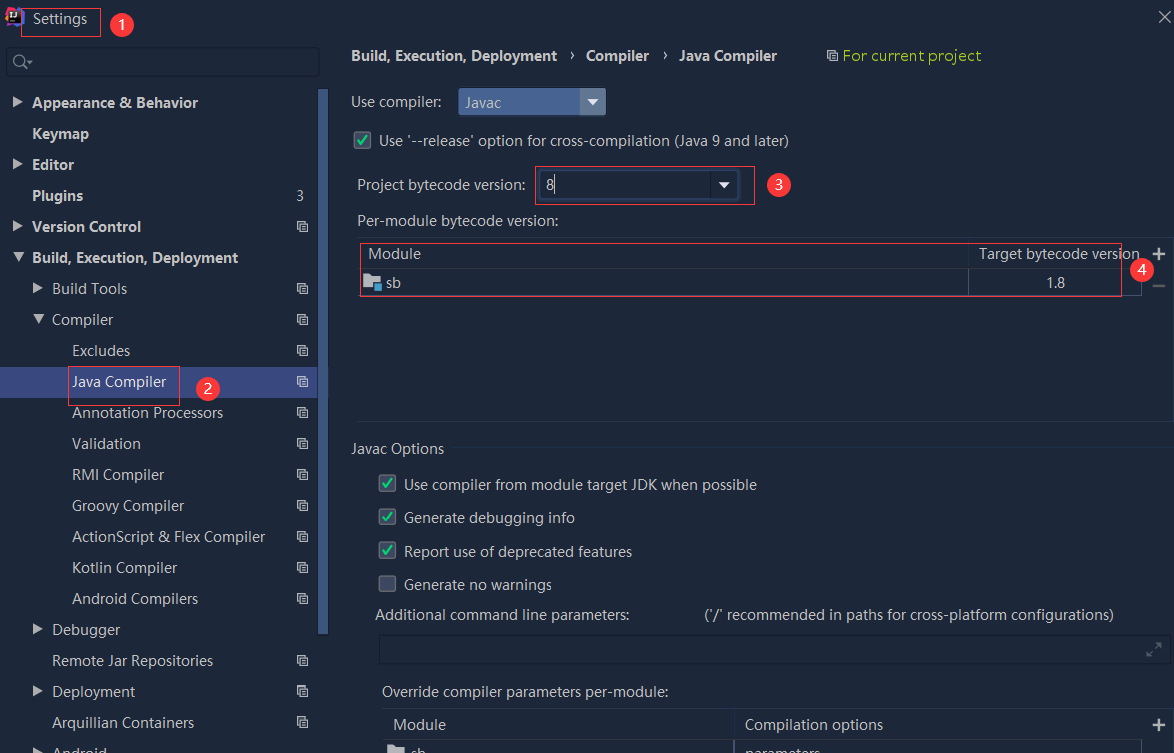

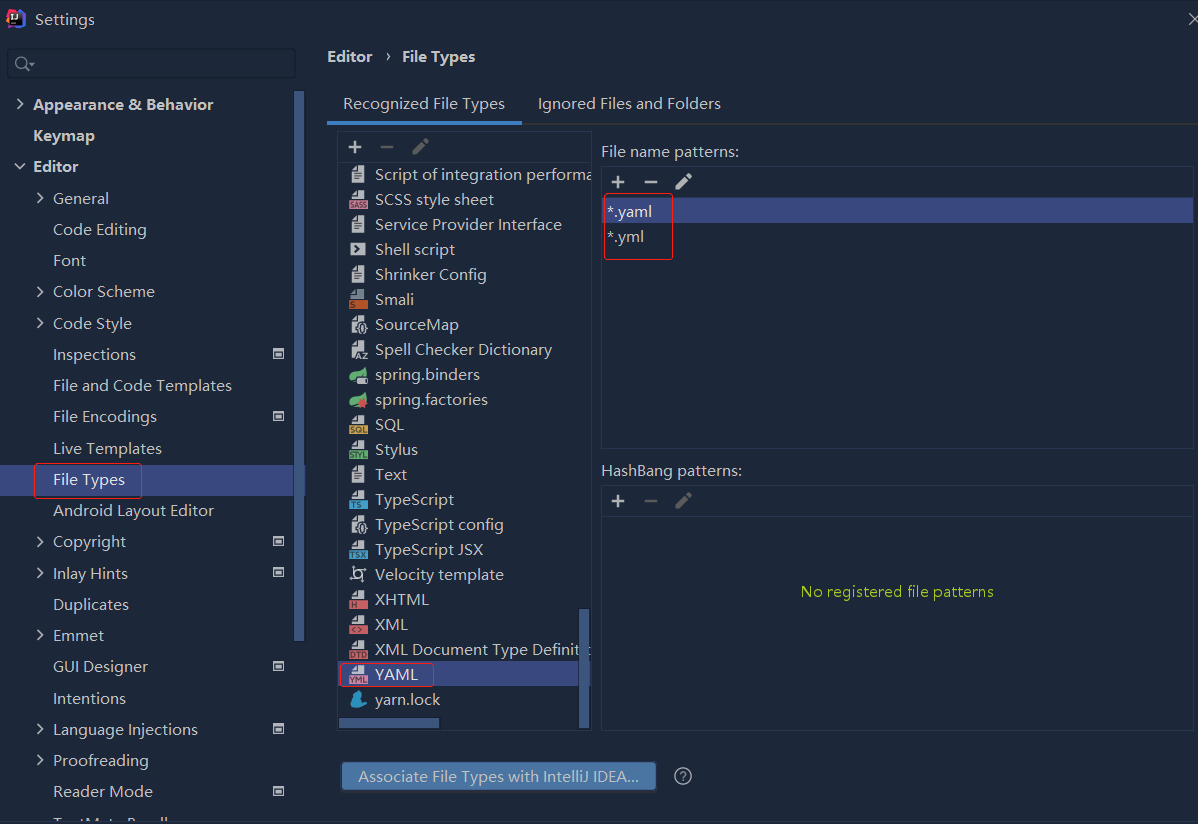

依赖报错 idea导入项目后依赖报错,解决方案:https://blog....

依赖报错 idea导入项目后依赖报错,解决方案:https://blog....

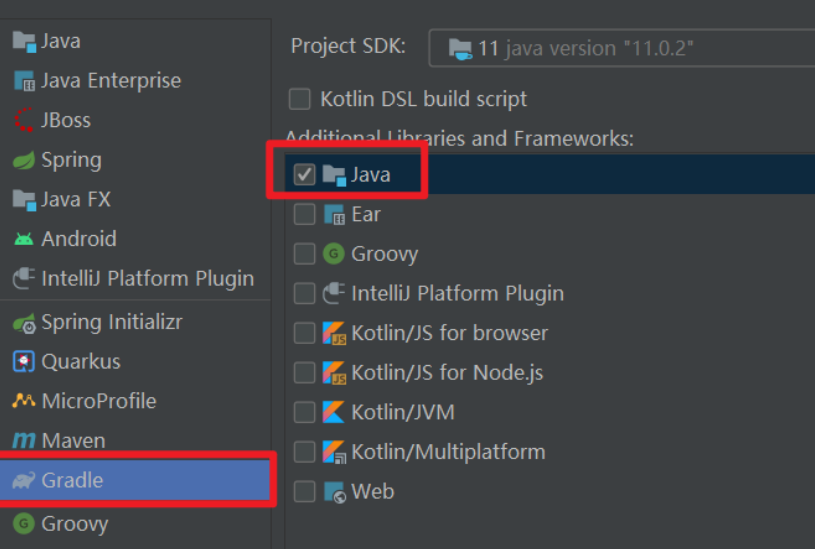

错误1:gradle项目控制台输出为乱码 # 解决方案:https://bl...

错误1:gradle项目控制台输出为乱码 # 解决方案:https://bl...