问题描述

我已经从SPSS过渡到语法编写/数据管理,在这里我转向python和pandas以实现更高级别的功能和编程。问题是,将SPSS文件读入熊猫太慢了。我使用更大的数据集(一百万或更多的行通常具有100多个列)。似乎有一些很酷的插件可以加快处理CSV文件的速度,例如Dask和Modin,但我认为这些插件不适用于SPSS文件。我想继续使用熊猫,但我必须坚持使用SPSS文件格式(这是我工作的其他所有人所使用的格式)。

在计算机升级和/或文件分块之外,还有什么技巧可以完成更快的数据处理?

解决方法

您可以尝试并行读取文件:

作为一个例子,我有一个文件“ big.sav”,它是294000行x 666列。使用pyreadstat.read_sav(这是pd.read_spss在后台使用的内容)读取文件需要115秒。通过并行化,我得到29秒:

首先,我创建一个文件worker.py:

def worker(inpt):

import pyreadstat

offset,chunksize,path = inpt

df,meta = pyreadstat.read_sav(path,row_offset=offset,row_limit=chunksize)

return df

然后在主脚本中我有这个:

import multiprocessing as mp

from time import time

import pandas as pd

import pyreadstat

from worker import worker

# calculate the number of rows in the file

_,meta = pyreadstat.read_sav("big.sav",metadataonly=True)

numrows = meta.number_rows

# calculate number of cores in the machine,this could also be set manually to some number,i.e. 8

numcores = mp.cpu_count()

# calculate the chunksize and offsets

divs = [numrows // numcores + (1 if x < numrows % numcores else 0) for x in range (numcores) ]

chunksize = divs[0]

offsets = [indx*chunksize for indx in range(numcores)]

# pack the data for the jobs

jobs = [(x,"big.sav") for x in offsets]

pool = mp.Pool(processes=numcores)

# let's go!

t0=time()

chunks = pool.map(worker,jobs)

t1=time()

print(t1-t0) # this prints 29 seconds

# chunks is a list of dataframes in the right order

# you can concatenate all the chunks into a single big dataframe if you like

final = pd.concat(chunks,axis=0,ignore_index=True)

编辑:

- pyreadstat版本1.0.3的性能已提高了约5倍。

- 此外,还添加了新功能“ read_file_multiprocessing”,该功能是该答案中共享的先前代码的包装。它最多可以放弃3倍的改进,比以前的版本提高15倍!

您可以使用以下功能:

import pyreadstat

fpath = "path/to/file.sav"

df,meta = pyreadstat.read_file_multiprocessing(pyreadstat.read_sav,fpath)

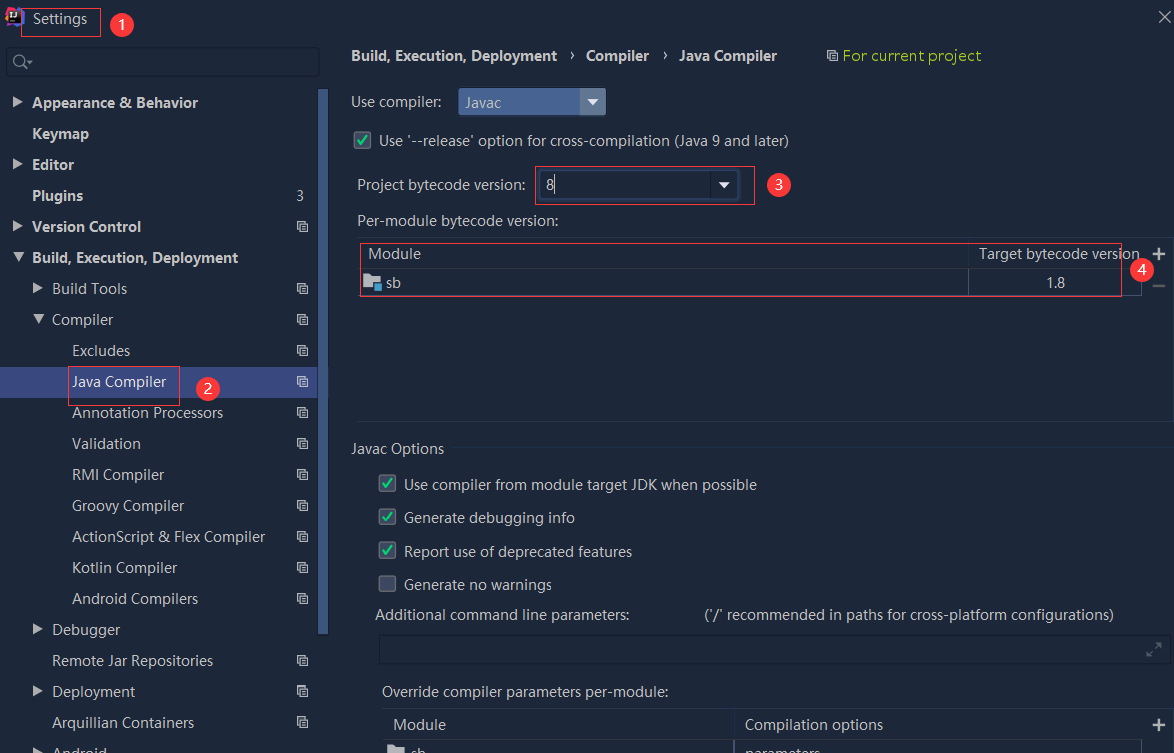

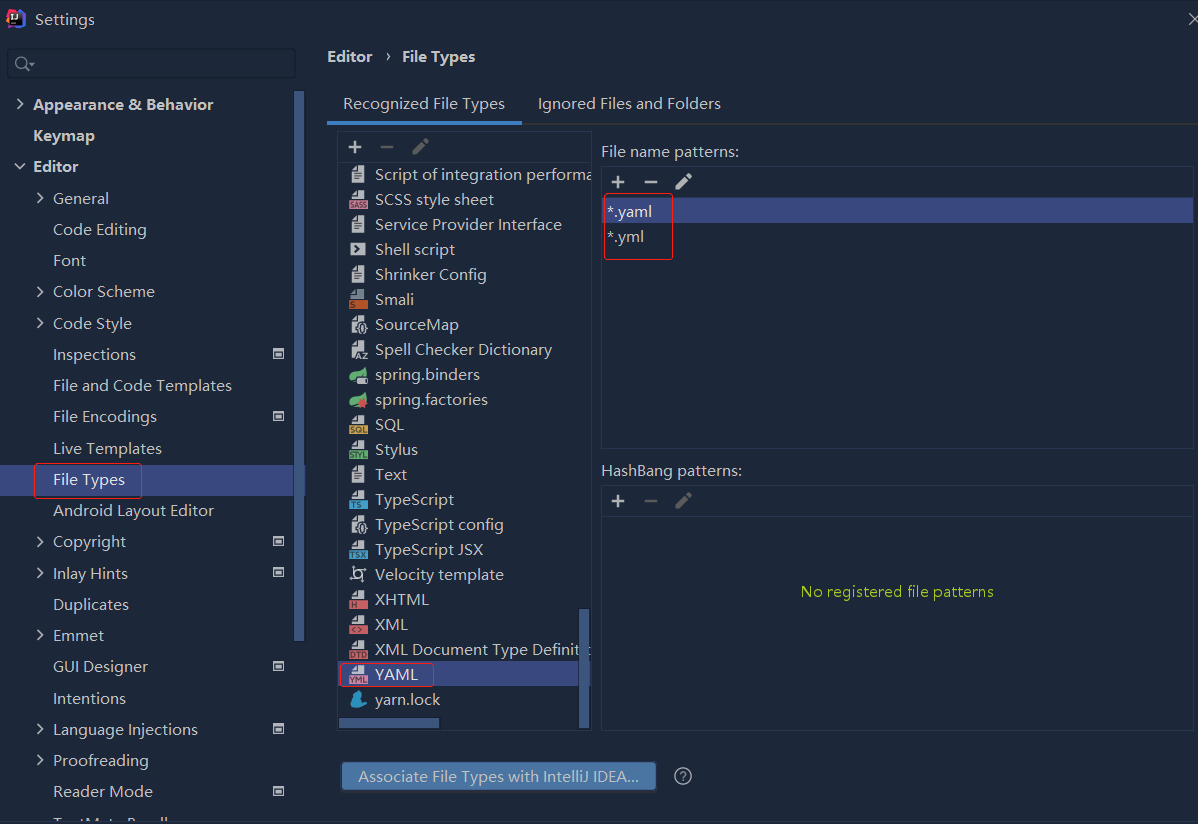

依赖报错 idea导入项目后依赖报错,解决方案:https://blog....

依赖报错 idea导入项目后依赖报错,解决方案:https://blog....

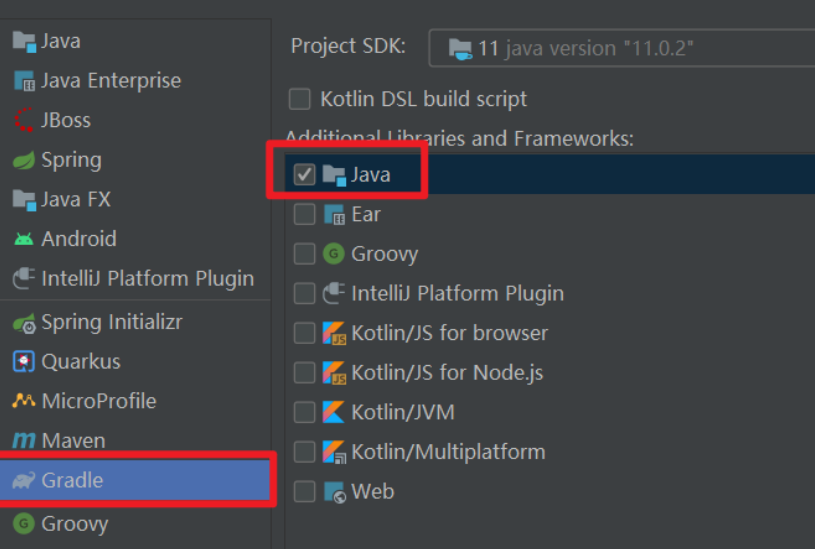

错误1:gradle项目控制台输出为乱码 # 解决方案:https://bl...

错误1:gradle项目控制台输出为乱码 # 解决方案:https://bl...