问题描述

问题:如何将存储在AWS S3中的jar提交给Local Spark?

我正在寻找一种将S3中存储的jar提交给Local Spark(不是EMR)的方法。 但是,当我对此进行调查时,只看到如何将其提交给EMR Spark Cluster。

与我一直在寻找的方法最接近的答案是在link中。 但是,以上答案似乎仅适用于EMR。 (不是吗?我可能是错的。)

解决方法

火花文档here说:

Spark使用以下URL方案允许不同的策略用于 传播罐子:

文件:-绝对路径和文件:/ URI由驱动程序的HTTP提供 文件服务器,每个执行者都从驱动程序HTTP中提取文件 服务器。

hdfs:,http:,https:,ftp:-这些下拉文件和JAR 从URI中获取

本地:-以local:/开头的URI是 预计将在每个工作节点上作为本地文件存在。

因此,只要您的s3存储桶是公开的,并且您可以使用URI对其进行访问,就可以指定上述其中之一

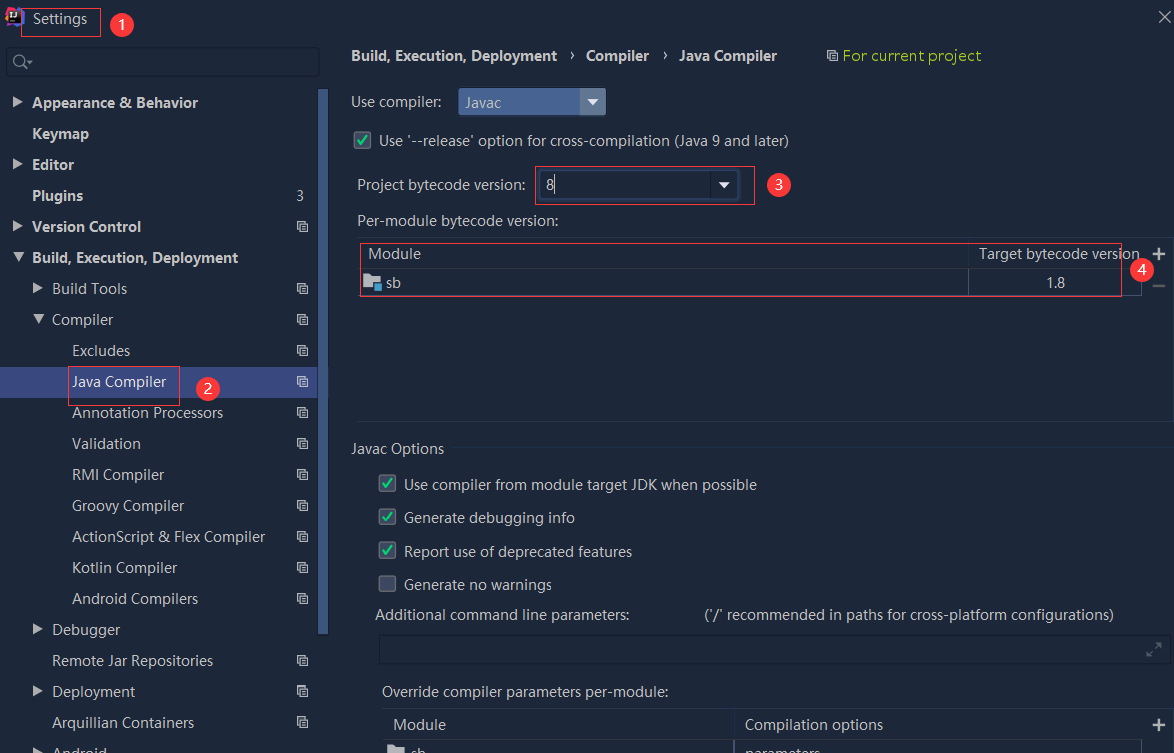

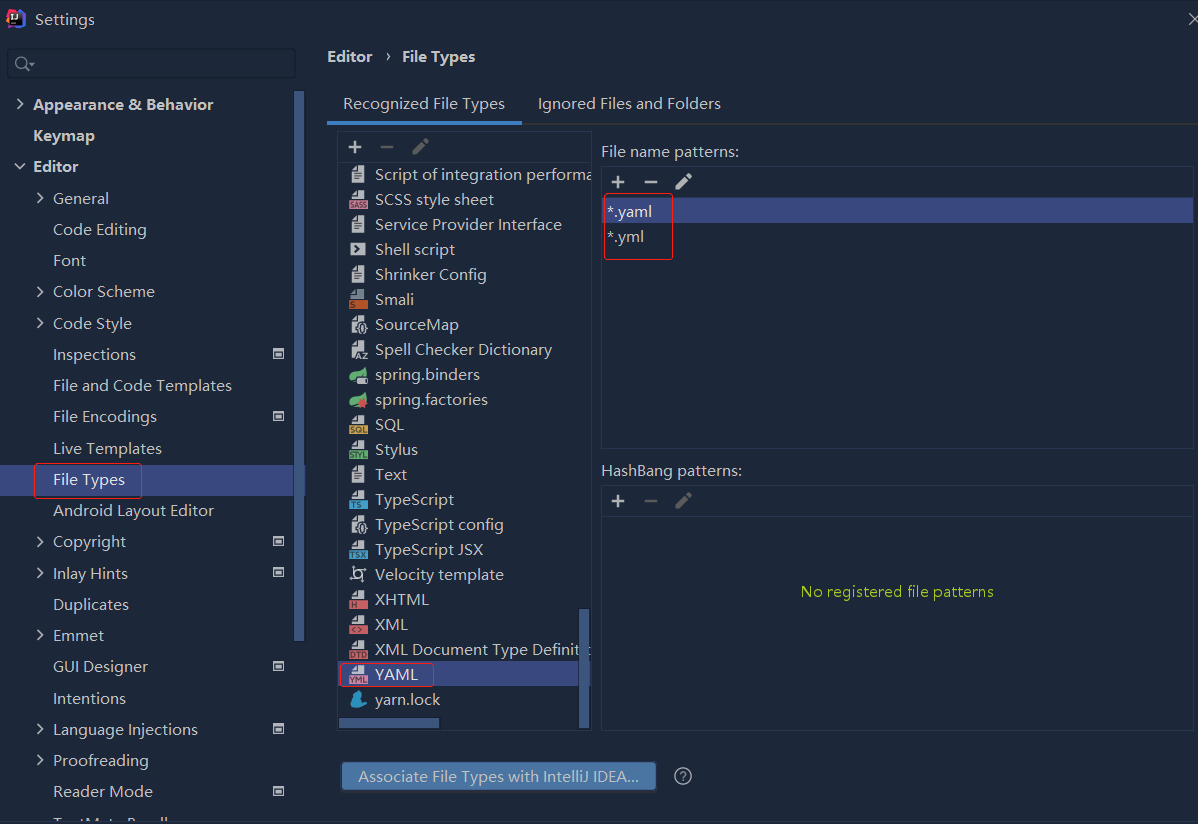

依赖报错 idea导入项目后依赖报错,解决方案:https://blog....

依赖报错 idea导入项目后依赖报错,解决方案:https://blog....

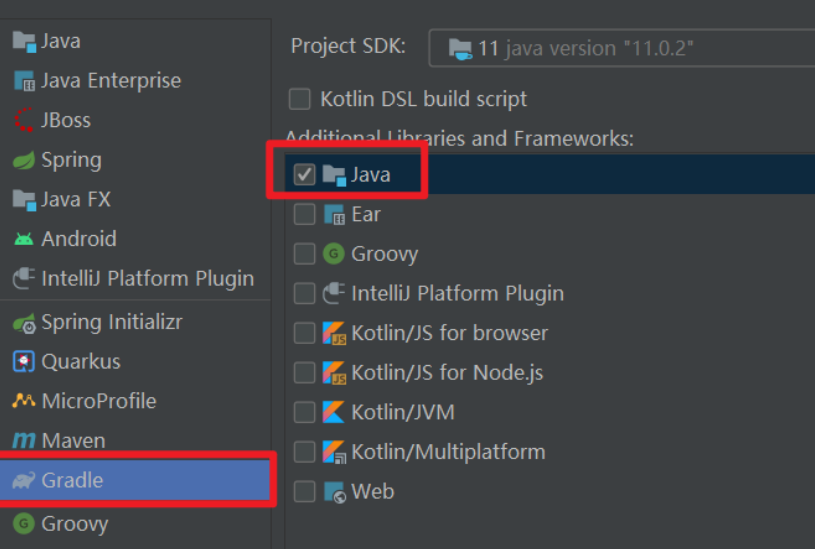

错误1:gradle项目控制台输出为乱码 # 解决方案:https://bl...

错误1:gradle项目控制台输出为乱码 # 解决方案:https://bl...