问题描述

我将基于Storm Crawler项目开发一个工件。我想从Kafka主题中获取种子URL。 Kakfa中的每个消息都有两个重要的字段:

解决方法

暂无找到可以解决该程序问题的有效方法,小编努力寻找整理中!

如果你已经找到好的解决方法,欢迎将解决方案带上本链接一起发送给小编。

小编邮箱:dio#foxmail.com (将#修改为@)

我将基于Storm Crawler项目开发一个工件。我想从Kafka主题中获取种子URL。 Kakfa中的每个消息都有两个重要的字段:

暂无找到可以解决该程序问题的有效方法,小编努力寻找整理中!

如果你已经找到好的解决方法,欢迎将解决方案带上本链接一起发送给小编。

小编邮箱:dio#foxmail.com (将#修改为@)

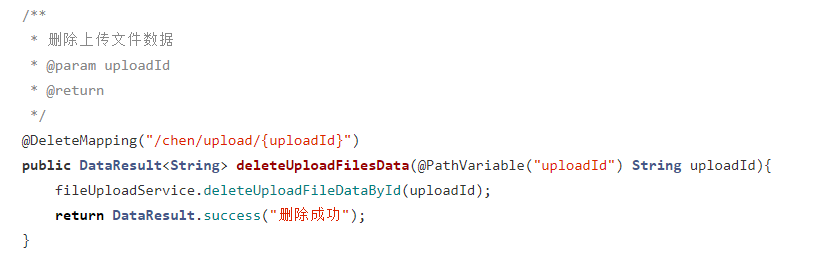

错误1:Request method ‘DELETE‘ not supported 错误还原:...

错误1:Request method ‘DELETE‘ not supported 错误还原:...