问题描述

问题系统由一个包含整个操作系统和 /home 目录的引导 SSD 构建,并带有一个由四个磁驱动器组成的 RAID 5 阵列,用于照片和下载等。当SSD突然拒绝写入时,我更换了备用并重新加载了Debian Buster。安装正常进行,但是当我尝试访问阵列时,它只显示一个空的 lost+found 文件夹。

我在所有四个驱动器上都运行了状态,并得到了

/dev/sda:

Magic : a92b4efc

Version : 1.2

Feature Map : 0x1

Array UUID : 5ce09c04:296aaae5:6f14f260:2723a660

Name : jove:0

Creation Time : Fri Dec 20 02:23:03 2019

Raid Level : raid5

Raid Devices : 4

Avail Dev Size : 3906764976 (1862.89 GiB 2000.26 GB)

Array Size : 5860147200 (5588.67 GiB 6000.79 GB)

Used Dev Size : 3906764800 (1862.89 GiB 2000.26 GB)

Data Offset : 264192 sectors

Super Offset : 8 sectors

Unused Space : before=264112 sectors,after=176 sectors

State : clean

Device UUID : 1d3d1925:506a5892:bc98196f:59cf2b21

Internal Bitmap : 8 sectors from superblock

Update Time : Wed Feb 17 21:47:32 2021

Bad Block Log : 512 entries available at offset 16 sectors

Checksum : 922745f8 - correct

Events : 6102

Layout : left-symmetric

Chunk Size : 512K

Device Role : Active device 0

Array State : AAAA ('A' == active,'.' == missing,'R' == replacing)

对于第一个设备,其他三个基本相同,正好有 6102 个事件,创建时间看起来差不多。我运行的其他报告之一,此时不记得了,显示大约 2% 的空间已被使用,这听起来也差不多,所以我希望数据在那里,只是某些人无法访问原因。

阵列按预期安装和卸载,并且阵列 UUID 与崩溃的 SSD 的 fstab 中的条目匹配。我花了大约三个小时在谷歌上搜索文章,检查 mdadm.conf,重新运行 initramfs,并运行 mdadm --assemble --scan 等。

我还没有尝试过的一件事是运行 create。有几篇文章暗示这可能是必要的,没有人说这会是一件非常糟糕的事情,但没有人说任何明确的事情。

我要试试

mdadm --create /dev/md0 --level=5 --raid-devices=4 /dev/sda /dev/sdb /dev/sdd /dev/sde

假设设备名称是正确的,这真的是个坏主意吗?

解决方法

暂无找到可以解决该程序问题的有效方法,小编努力寻找整理中!

如果你已经找到好的解决方法,欢迎将解决方案带上本链接一起发送给小编。

小编邮箱:dio#foxmail.com (将#修改为@)

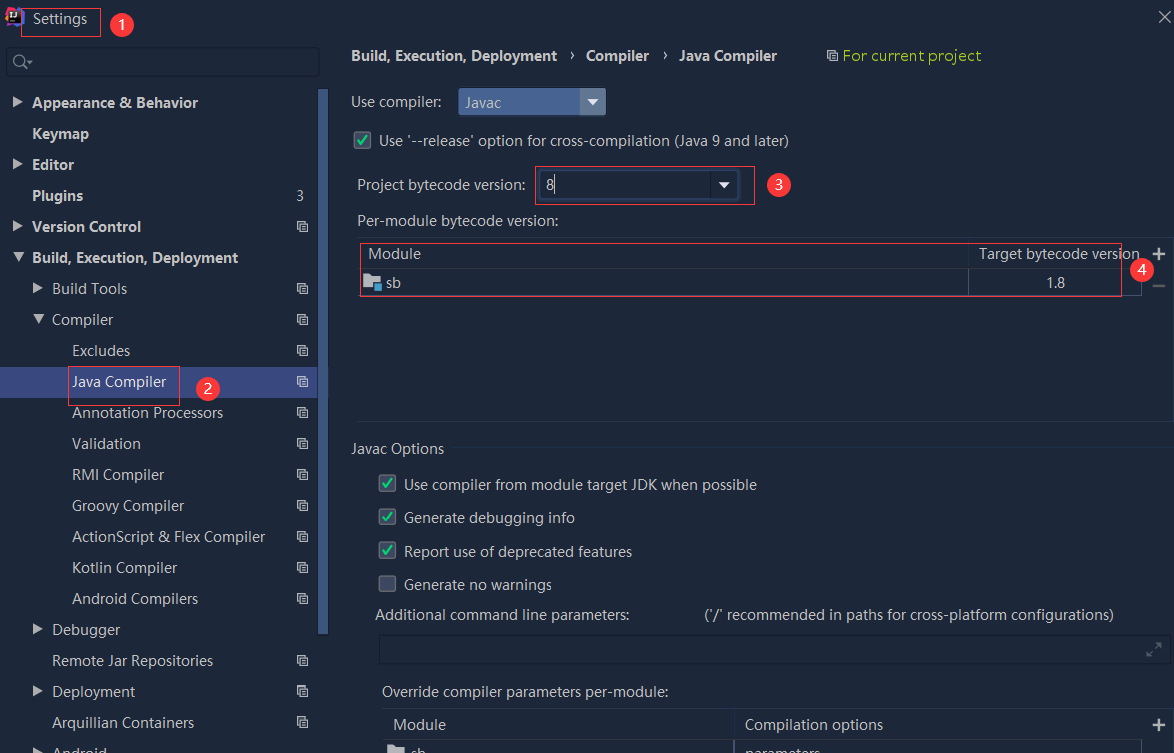

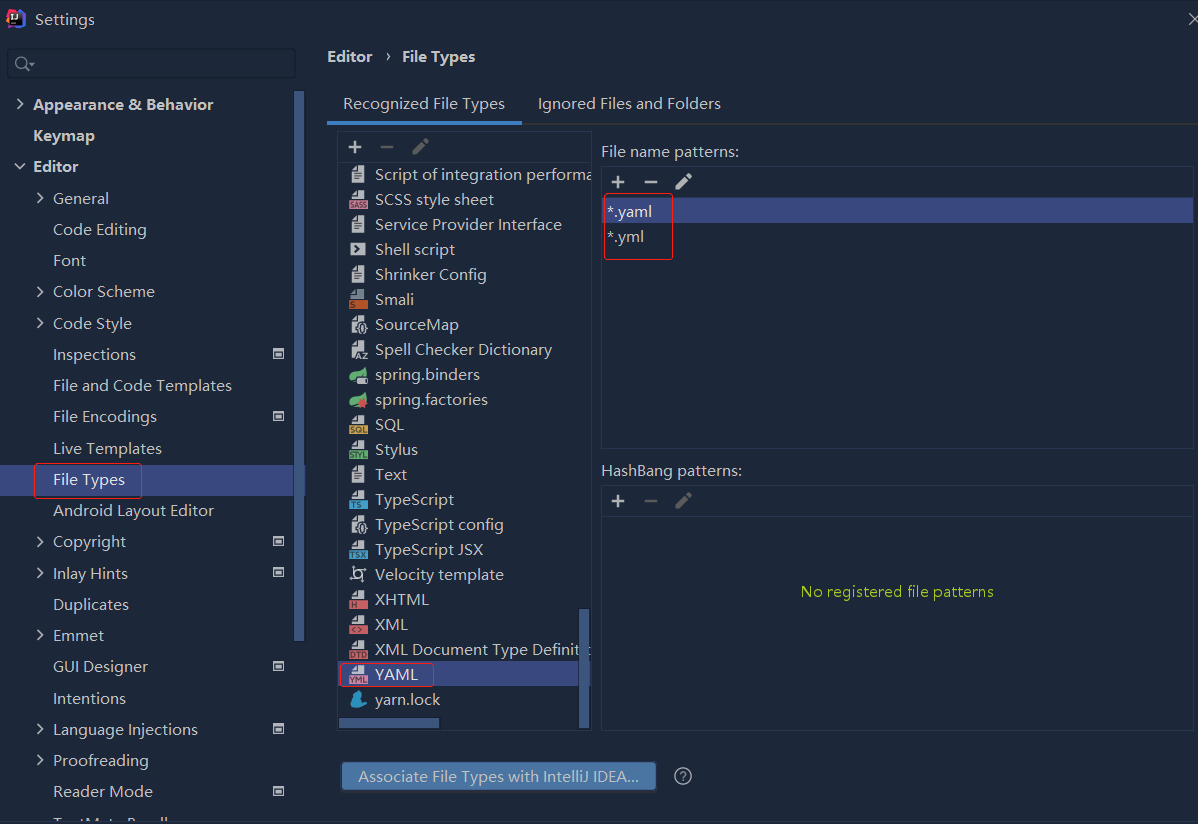

依赖报错 idea导入项目后依赖报错,解决方案:https://blog....

依赖报错 idea导入项目后依赖报错,解决方案:https://blog....

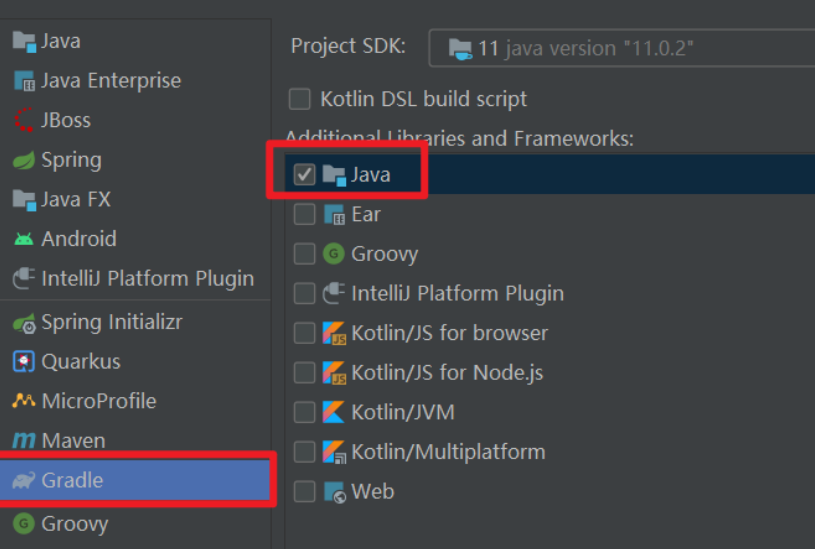

错误1:gradle项目控制台输出为乱码 # 解决方案:https://bl...

错误1:gradle项目控制台输出为乱码 # 解决方案:https://bl...