问题描述

我正在尝试下载总共 29GB 的“librispeech_asr”数据集,但由于 google colab 的空间有限,我无法下载/加载数据集,即笔记本崩溃。

所以我做了一些研究,发现我们可以在 split 函数中传递的 load_dataset 参数下载部分数据集,但它仍然在 notebook 上下载整个 30GB 数据集。参数 split 不起作用...

from datasets import load_dataset

dataset = load_dataset("librispeech_asr",'clean',split=['train.360[:50%]','validation'])

我试图只加载 50% 的“train.360”数据,但我无法加载。

什么是正确的方法,我做错了什么?

解决方法

暂无找到可以解决该程序问题的有效方法,小编努力寻找整理中!

如果你已经找到好的解决方法,欢迎将解决方案带上本链接一起发送给小编。

小编邮箱:dio#foxmail.com (将#修改为@)

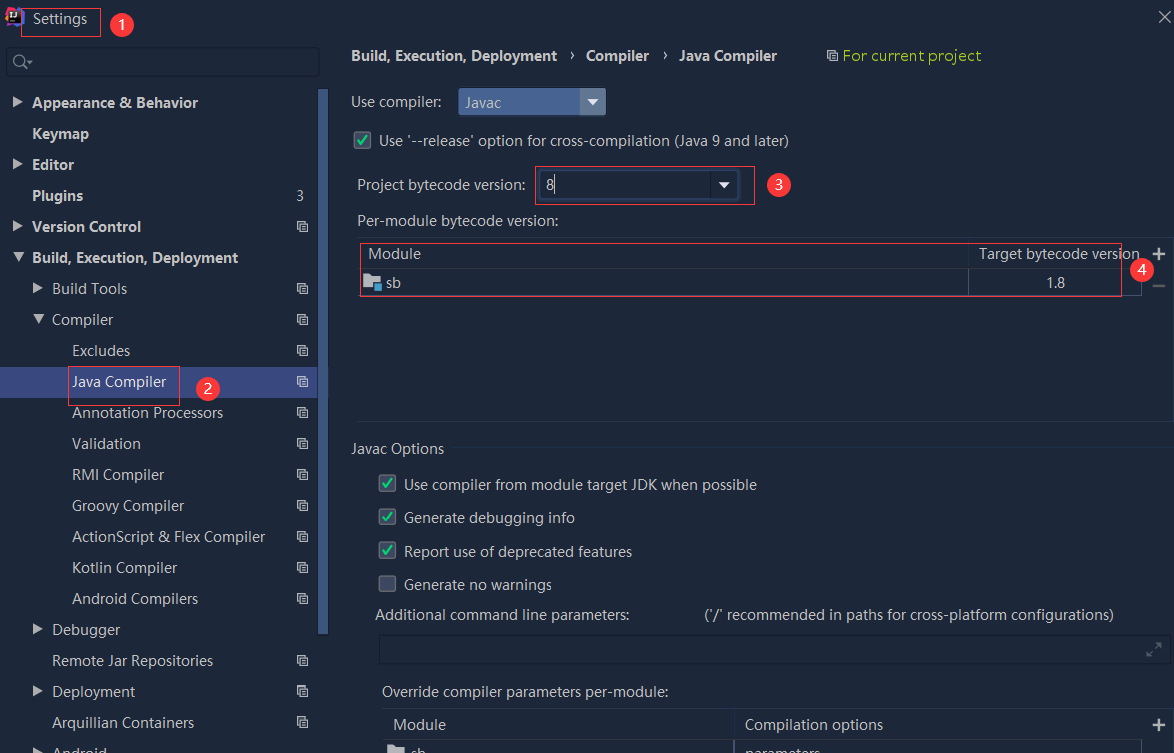

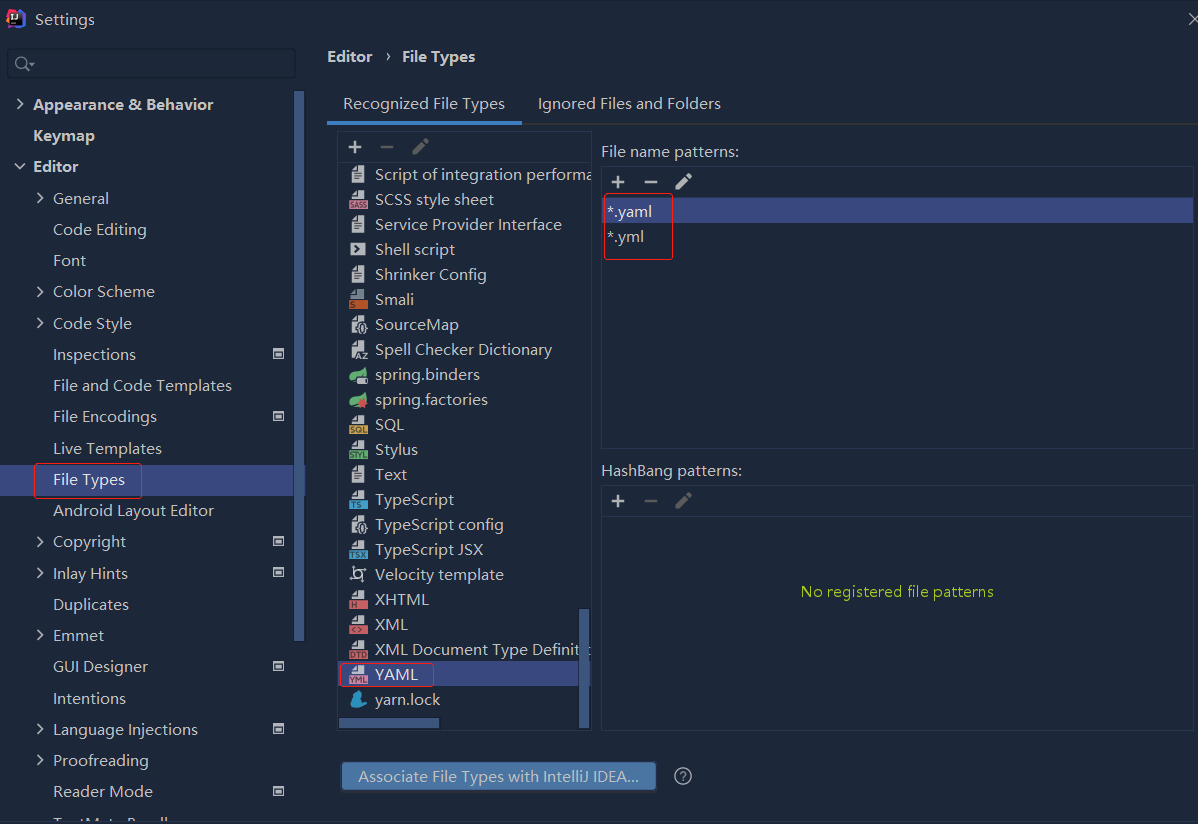

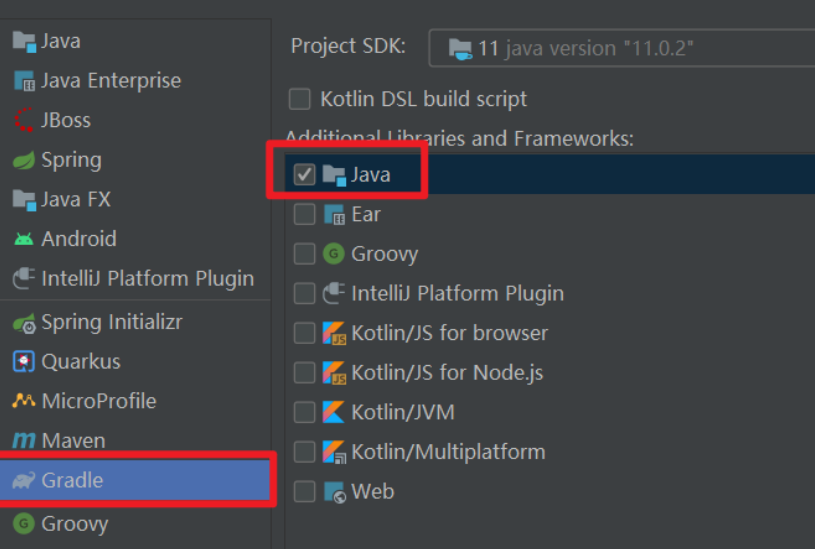

依赖报错 idea导入项目后依赖报错,解决方案:https://blog....

依赖报错 idea导入项目后依赖报错,解决方案:https://blog....

错误1:gradle项目控制台输出为乱码 # 解决方案:https://bl...

错误1:gradle项目控制台输出为乱码 # 解决方案:https://bl...