我正在使用Python 2.7& jupyter笔记本中的Spark 2.0.2试图访问另一个Docker容器中的mySql数据库.我已经实施了几乎所有可以解决的问题,但仍然无法解决. This是我的模型,因此至少之前已经做过类似的工作.我将笔记本和Dockerfile放在了“ mysql”分支here的公共存储库中以供参考.

失败的代码:

df = (spark.read.format('jdbc')

.options(

url='jdbc:mysql://172.17.0.8:6603/giskard',user='root',password='datascience',dbtable='supers',driver='com.mysql.jdbc.Driver')

.load()

)

与(摘录,上面引用的笔记本中的完整列表):

Py4JJavaError: An error occurred while calling o42.load.

: java.lang.ClassNotFoundException: com.mysql.jdbc.Driver

at java.net.URLClassLoader$1.run(URLClassLoader.java:366)

在dockerfile内,我添加了所有可能的解决方案:

RUN apt-get update && apt-get install -y --no-install-recommends apt-utils && \

apt-get install -y mysql-client && \

apt-get install -y python-dev && \

apt-get install -y libmysqlclient-dev && \

apt-get install -y libmysql-java && \

apt-get clean

RUN pip2 install MySQL-python

我确认容器中存在mysql jar文件,然后将其添加到SPARK_OPTS中,以便在笔记本中生成%env:

'SPARK_OPTS': '--driver-java-options=-Xms1024M --driver-java-options=-Xmx4096M --driver-java-options=-Dlog4j.logLevel=info --spark-jars=/usr/share/java/mysql-connector-java.jar',环境的其他可能相关部分:

'PATH': '/opt/conda/bin:/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin','PYSPARK_PYTHON': '/opt/conda/envs/python2/bin/python','PYTHONPATH': '/usr/local/spark/python:/usr/local/spark/python/lib/py4j-0.10.4-src.zip:/usr/lib/python2.7/dist-packages','SPARK_HOME': '/usr/local/spark',我尝试访问的数据库确实存在数据.我使用的过程记录在笔记本的第一个单元格中.我让这个变得太复杂了吗?我缺少什么,还有什么可以尝试的?我感谢您提供解决方案的任何方向!

最佳答案

我通过退后一步来查看是否可以通过python访问数据库并使用ps -aux检查容器内部的spark进程来解决问题

1)所有容器必须在同一网络上进行通信;链接显然还不够.我用了一个新的:

泊坞窗网络创建-驱动程序桥dbnet

2)我安装了python-mysqldb通过python访问数据库.我在笔记本中执行了此操作,而不是将其添加到dockerfile中.

!sudo apt-get update && sudo apt-get install -y python-mysqldb

# from https://pypi.python.org/pypi/MySQL-python/1.2.5

import MySQLdb

db = MySQLdb.connect(host=DB_SERVER_IP,# your host,usually localhost

user=MYSQL_USER,# your username

passwd=MYSQL_PASSWORD,# your password

db=MYSQL_DATABASE) # name of the data base

3)Spark需要libmysql-java并将jar文件复制到/usr/local/spark / jars.据我所知,docker SPARK_OPTS设置无效.我添加到Dockerfile中:

RUN apt-get update && apt-get install -y --no-install-recommends apt-utils && \

apt-get install -y libmysql-java && \

apt-get clean

RUN ln -s /usr/share/java/mysql-connector-java.jar /usr/local/spark/jars

现在一切都很好.如果其他人需要我的确切步骤,我将把示例笔记本留在spark 2 docker repository的mysql分支中.

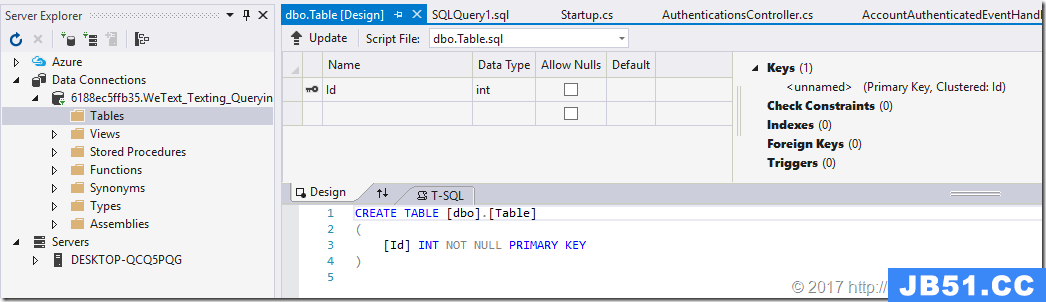

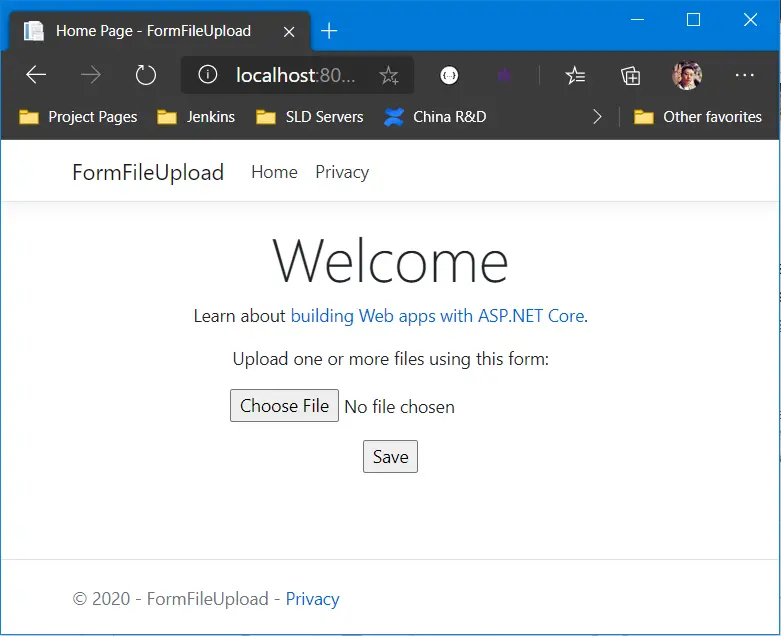

最近一直在开发Apworks框架的案例代码,同时也在一起修复Apw...

最近一直在开发Apworks框架的案例代码,同时也在一起修复Apw... 最近每天都在空闲时间努力编写Apworks框架的案例代码WeText。...

最近每天都在空闲时间努力编写Apworks框架的案例代码WeText。... 在《Kubernetes中分布式存储Rook-Ceph部署快速演练》文章中,...

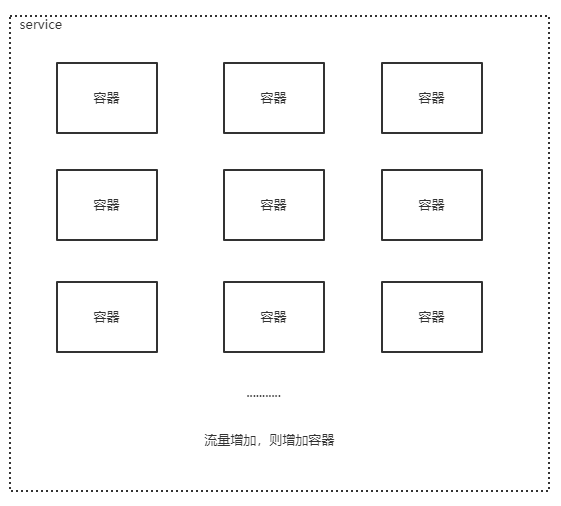

在《Kubernetes中分布式存储Rook-Ceph部署快速演练》文章中,... CentOS下Docker与.netcore(一) 之 安装 CentOS下Docker与.ne...

CentOS下Docker与.netcore(一) 之 安装 CentOS下Docker与.ne... CentOS下Docker与.netcore(一) 之 安装 CentOS下Docker与.ne...

CentOS下Docker与.netcore(一) 之 安装 CentOS下Docker与.ne...