0.写在前面

软件版本:VM14,Centos 7,hadoop 2.5,jdk 1.8

本文是接上一篇虚拟机的设置的之后开始的,建议先看前一篇。

jdk 1.8官网下载:https://www.oracle.com/technetwork/java/javase/downloads/jdk8-downloads-2133151.html

hadoop 2.5官网下载:https://archive.apache.org/dist/hadoop/common/hadoop-2.5.0/

建议阅读本文前先浏览有关虚拟机的新建及网络配置:https://blog.csdn.net/qq_40471761/article/details/88557696

1.网络配置

1.1查找配置文件

su //更改当前用户为root用户 cd /etc/sysconfig/network-scripts //进入指定目录下修改IP地址的配置 ll //查看当前目录的文件

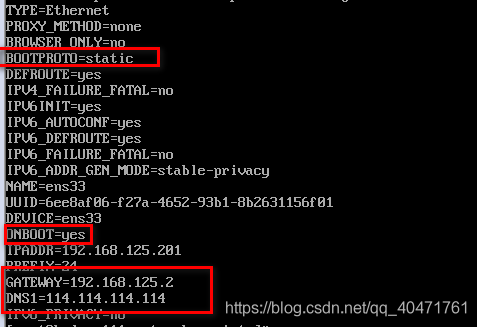

1.2更改配置文件

默认情况下 ifcfg-ens33为ip地址的配置文件,使用vi命令编辑

(若为只读,使用 chmod u+x ifcfg-ens33 命令,增加写权限)

1.3重启网络服务

systemctl restart network.service

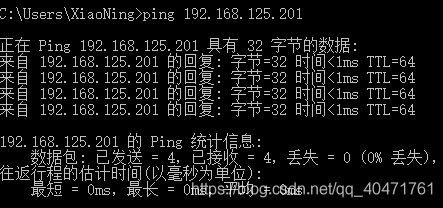

1.4在宿主机进行测试

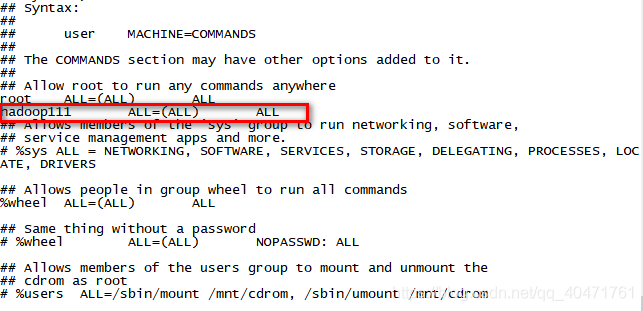

2.给用户增加sudo权限

vi /etc/sudoers //编辑sudo的配置文件(若文件为只读,则增加文件写操作,具体操作见1.2)

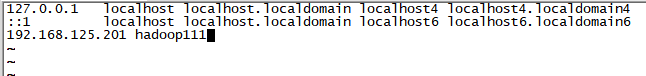

3.修改hosts文件

添加ip地址与主机名之间的映射关系(若为分布式搭建,则将主从节点的映射关系都添加)

4.关闭防火墙

systemctl stop firewalld //临时关闭防火墙 systemctl disable firewalld //关闭防火墙自启动

5.SSH免密登录

本机之间(主从机之间)都需要配置

//从root用户退回自建用户 ssh-keygen -t rsa //生成秘钥,提示输入时,一直敲回车即可 ssh-copy-id 192.168.125.201//根据实际情况修改地址

6.安装jdk

6.1上传jdk安装包

6.2解压jdk安装包并重命名

tar -zxvf jdk-8u202-linux-x64.tar.gz -C ./ //解压缩 mv jdk-8u202-linux-x64.tar.gz jdk //重命名

6.3修改环境变量

sudo vi /etc/profile //编辑文件 export JAVA_HOME=/apps/jdk export PATH=$PATH:$JAVA_HOME/bin //文件末尾增加(路径根据实际情况更改)

6.4刷新环境变量

source /etc/profile

6.5验证

java -version

7.安装hadoop

7.1上传安装包

7.2解压安装包并重命名

tar -zxvf hadoop-2.5.0.tar.gz -C ./ //解压缩 mv hadoop-2.5.0.tar.gz hadoop //重命名

7.3修改配置文件

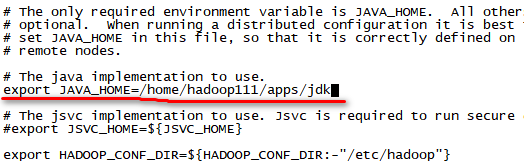

hadoop-env.sh

添加jdk的路径

============

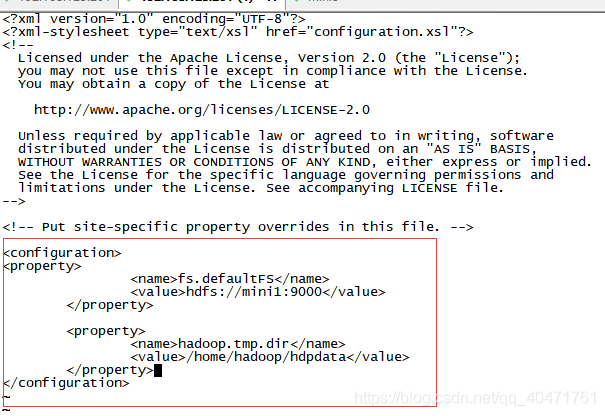

core-site.xml

注意这里设置的文件系统地址为 9000(有版本推荐设置为8020,可以自行更改)

<property>

<name>fs.defaultFS</name>

<value>hdfs://主机名/IP地址:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/home/hadoop111/hadoop/hdpdata</value>

</property>

================

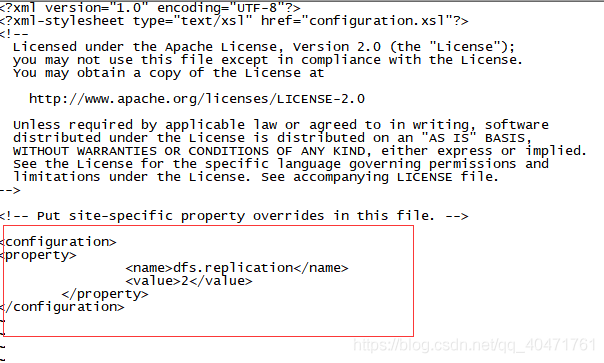

hdfs-site.xml

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

=======================

yarn-site.xml

<property>

<name>yarn.resourcemanager.hostname</name>

<value>主机名/IP地址</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

==========

mapred-site.xml

mv mapred-site.xml.template mapred-site.xml //重命名模板文件

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

==================

slaves

在其中加入从节点的IP

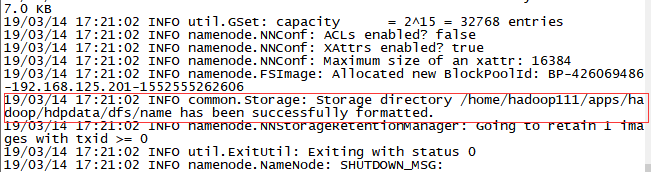

7.4格式化namenode

bin/hadoop namenode -format

格式化成功

7.5启动hadoop

sbin/start-all.sh

7.6验证

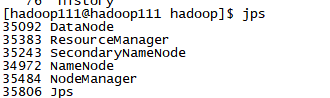

1.jps命令

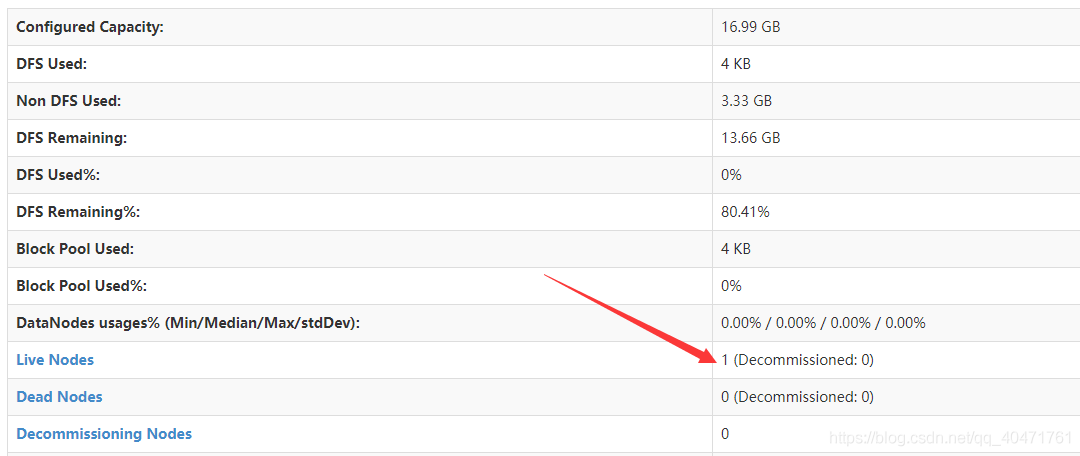

2.浏览器端

至此配置完成

觉得有帮助,请点赞加个关注

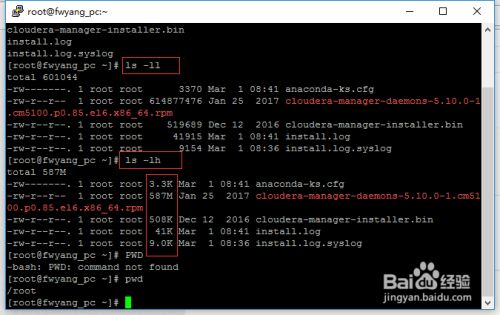

最简单的查看方法可以使用ls -ll、ls-lh命令进行查看,当使用...

最简单的查看方法可以使用ls -ll、ls-lh命令进行查看,当使用...